Лейкхаус архитектура: объединение DWH и Data Lake

мая, 3 2026

мая, 3 2026

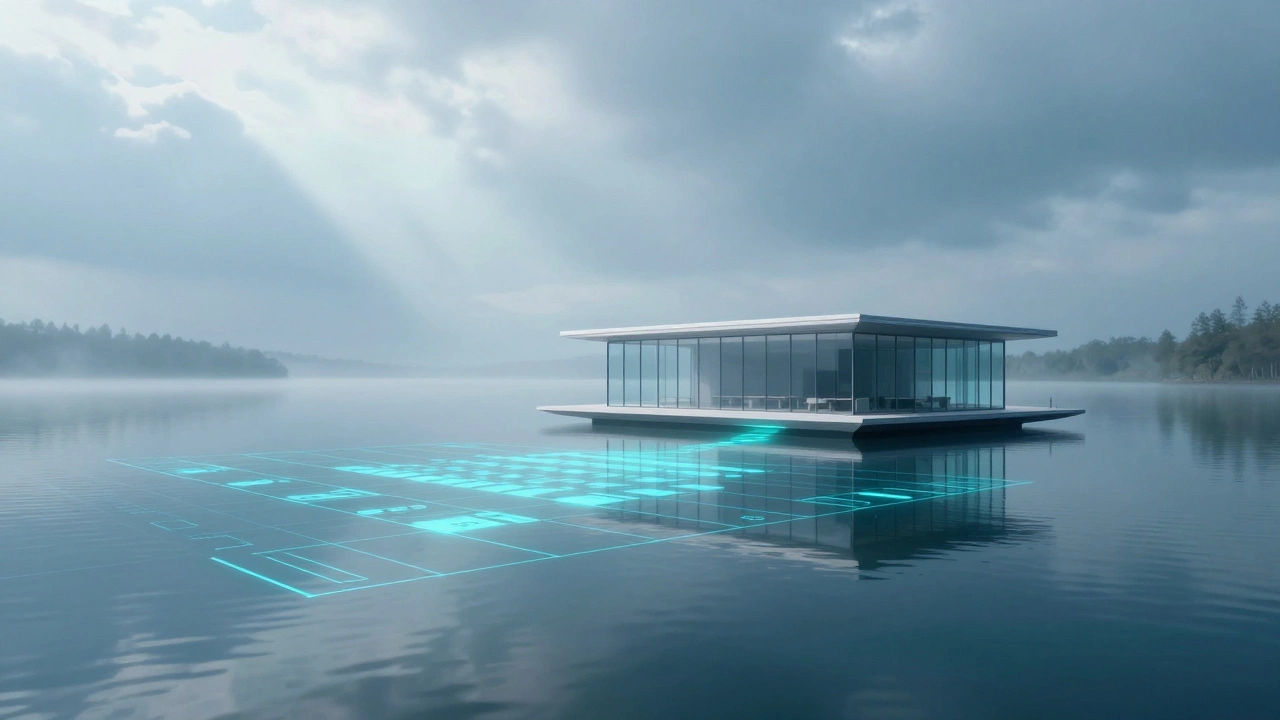

В 2026 году мы больше не можем позволить себе выбирать между «гибкостью» и «порядком». Раньше инженеры ставили жесткую рамку: либо строим классическое хранилище данных (DWH), которое дает идеальную структуру для отчетов, но стоит как крыло самолета, либо разворачиваем озеро данных (Data Lake), где можно хранить всё подряд - от логов до видео, но рискуем превратить его в болото. Сегодня эти два лагеря объединились. На сцене появился Lakehouse (лейкхаус) - архитектура, которая позволяет работать со всеми типами данных в одном месте, сохраняя при этом строгие правила управления.

Что такое лейкхаус и почему он изменил правила игры

Концепция Lakehouse зародилась около 2020 года, когда компания Databricks официально представила эту модель вместе с архитектурой медальонов (Medallion Architecture). Идея была проста, но революционна: зачем платить за два разных хранилища и тратить время на копирование данных из одного в другое?

Лейкхаус устраняет необходимость в отдельном реляционном хранилище. Он использует единый репозиторий на базе объектного хранилища (например, S3 или HDFS), но поверх него накладывает слой транзакционной обработки. Это значит, что вы можете хранить сырые файлы изображений, полуструктурированные JSON-логи и строгие таблицы продаж в одной системе. При этом SQL-запросы будут работать так же быстро и надежно, как в традиционном DWH.

Главная проблема старых Data Lake заключалась в отсутствии контроля. Данные приходили, их никто не проверял, и через полгода аналитики переставали им доверять. Лейкхаус решает эту проблему, внедряя принудительное управление схемами и обеспечивая целостность данных.

Как устроен лейкхаус: слои и технологии

Чтобы понять, как это работает, нужно заглянуть под капот. Лейкхаус состоит из двух основных частей:

- Хранилище (Storage): Обычно это дешевое облачное объектное хранилище или файловая система. Здесь лежат данные в открытых форматах, таких как Apache Parquet или Avro. Эти форматы позволяют эффективно сжимать данные и читать только нужные колонки.

- Слой таблиц (Table Format Layer): Это «мозг» системы. Именно здесь происходит магия. Поверх файлов ложится метаданные-слой, который управляет версиями, транзакциями и индексами.

На данный момент существует три главных стандарта этого слоя, которые обеспечивают совместимость и ACID-транзакции (атомарность, согласованность, изолированность, долговечность):

- Apache Iceberg: Открытый стандарт, поддерживаемый многими движками (Trino, Spark, Flink). Отлично подходит для кросс-платформенной работы.

- Delta Lake: Решение от Databricks, глубоко интегрированное с их экосистемой.

- Apache Hudi: Фокусируется на обновлении записей в реальном времени, что важно для стриминговых задач.

Благодаря этим технологиям, вы получаете возможность делать Time Travel (возвращаться к состоянию базы на определенную дату) и выполнять операции Upsert (обновление или вставка), которые раньше были невозможны в озерах данных.

Сравнение: DWH vs Data Lake vs Lakehouse

Выбор архитектуры зависит от того, какие задачи стоят перед бизнесом. Давайте посмотрим на различия более детально.

| Критерий | DWH (Хранилище) | Data Lake (Озеро) | Lakehouse (Лейкхаус) |

|---|---|---|---|

| Типы данных | Строго структурированные | Любые (структ., полу-, нестр.) | Любые, с поддержкой схем |

| Стоимость хранения | Высокая | Низкая | Низкая (как у Lake) |

| Производительность SQL | Очень высокая | Низкая / Средняя | Высокая |

| Поддержка ML/AI | Сложная интеграция | Отличная | Отличная (единый доступ) |

| Управление данными | Строгое (Schema-on-write) | Гибкое (Schema-on-read) | Строгое + Гибкость |

Классический DWH все еще остается королем для чистых BI-отчетов в небольших компаниях с ограниченными бюджетами на разработку. Но как только объемы данных превышают 150 ГБ в сутки, стоимость DWH начинает расти экспоненциально. Data Lake решает проблему масштабируемости, но требует огромных усилий по поддержке качества данных. Лейкхаус занимает золотую середину: он масштабируется дешево, но обеспечивает контроль, необходимый для принятия бизнес-решений.

Архитектура медальонов: путь данных в лейкхаусе

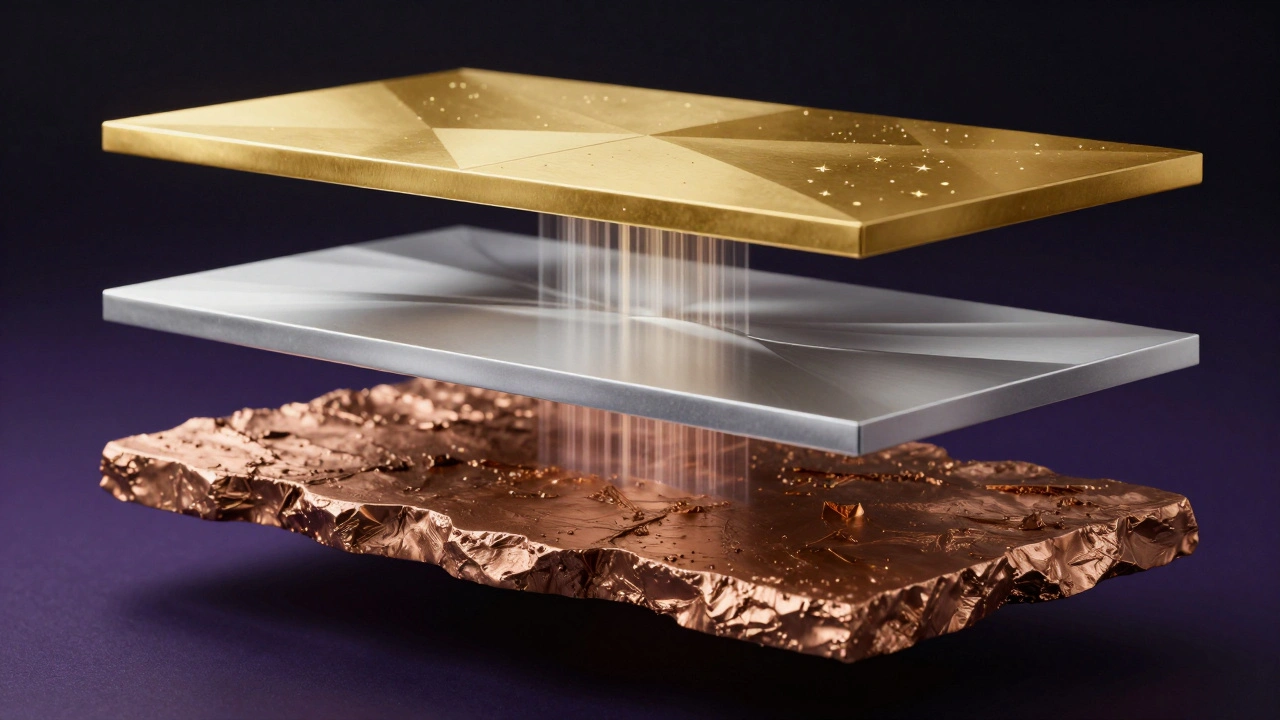

Чтобы данные не превратились в хаос, в лейкхаусах активно используется концепция Medallion Architecture. Она разделяет данные на три уровня качества:

- Bronze (Бронзовый слой): Сырые данные. Сюда попадает всё, что приходит из источников: логи приложений, события с мобильных устройств, выгрузки из CRM. Схема может быть любой, дубликаты допускаются. Это архивная копия.

- Silver (Серебряный слой): Очищенные данные. Здесь происходит обогащение, удаление дубликатов и приведение типов. Данные становятся надежными, но все еще находятся в сыром виде (например, нормализованные таблицы).

- Gold (Золотой слой): Бизнес-готовые данные. Это агрегированные таблицы, оптимизированные под конкретные задачи аналитики. Часто используются модели «Звезда» или «Снежинка», знакомые каждому аналитику DWH. Именно этот слой подключают к Tableau, Power BI или Looker.

Такой подход позволяет инженерам безопасно экспериментировать на нижних уровнях, не ломая отчеты, которые смотрят руководители.

Преимущества перехода на Lakehouse

Почему компании переходят на эту архитектуру прямо сейчас? Вот ключевые факторы:

1. Единая точка истины. Больше нет необходимости поддерживать ETL-процессы, которые копируют данные из Lake в Warehouse. Это экономит часы разработки и снижает риск рассинхронизации. Аналитик и Data Scientist работают с одними и теми же файлами.

2. Разделение вычислений и хранения. В лейкхаусе хранилище отделено от вычислительного кластера. Вы можете масштабировать вычисления независимо от объема данных. Нужно запустить тяжелую тренировочную модель ML? Добавьте ноды в кластер Spark. Нужен быстрый дашборд? Запустите легковесный SQL-движок вроде Trino. Оплата идет только за используемые ресурсы.

3. Открытые форматы. Используя Apache Iceberg или Delta Lake, вы избегаете vendor lock-in (привязки к одному вендору). Ваши данные остаются вашими, и вы можете менять инструменты обработки без миграции самих файлов.

Когда стоит выбрать лейкхаус, а когда лучше остаться на старом

Несмотря на всю привлекательность, Lakehouse - не панацея. Если ваша компания собирает меньше 10 терабайт данных, и вся аналитика сводится к нескольким ежедневным отчетам в Excel, классическое DWH будет проще и дешевле в поддержке. Вам не нужна сложная инфраструктура для простых задач.

Однако, если вы планируете внедрять машинное обучение, работать с потоковыми данными (Real-time analytics) или имеете разношерстные источники (IoT-датчики, тексты, картинки), лейкхаус становится обязательным условием. Он дает гибкость для будущего роста, не требуя полной переделки архитектуры через год.

Переход обычно происходит постепенно. Сначала команда разворачивает Data Lake для сбора всех данных. Затем, когда возникает потребность в стабильных отчетах, поверх него добавляют слой таблиц (Iceberg/Hudi). И только после этого старые хранилища DWH начинают поэтапно выводить из эксплуатации.

Чем отличается Lakehouse от Data Lake?

Data Lake - это просто место для хранения любых файлов без строгого контроля. Lakehouse добавляет поверх файлов слой управления транзакциями, схемами и метаданными, что позволяет выполнять быстрые SQL-запросы и гарантировать целостность данных, как в хранилище (DWH).

Какие технологии лежат в основе Lakehouse?

Основу составляют открытые форматы таблиц, такие как Apache Iceberg, Delta Lake и Apache Hudi. Они работают поверх объектных хранилищ (S3, Azure Blob) и используют колоночные форматы файлов, например, Apache Parquet, для высокой производительности чтения.

Можно ли использовать Lakehouse для Machine Learning?

Да, это одно из главных преимуществ. Поскольку данные хранятся в открытом формате, библиотеки Python (Pandas, PyTorch) и R могут обращаться к ним напрямую, минуя сложные процессы экспорта из закрытых DWH.

Стоит ли migrating с DWH на Lakehouse?

Если ваши объемы данных растут быстрее, чем бюджет на лицензии DWH, или вам нужно объединить аналитику и ML в одном контуре, то да. Однако для небольших проектов с простой отчетностью классическое DWH может оставаться более простым решением.

Что такое Medallion Architecture?

Это метод организации данных внутри Lakehouse, состоящий из трех слоев: Bronze (сырые данные), Silver (очищенные и обогащенные) и Gold (агрегированные данные для бизнеса). Это помогает контролировать качество информации на каждом этапе обработки.