Качество данных: как профилирование и очистка наборов данных улучшают аналитику

мар, 10 2026

мар, 10 2026

Если вы работаете с данными - даже просто таблицами в Excel - вы наверняка сталкивались с ситуацией, когда отчеты дают странные результаты, а руководство спрашивает: "Почему так?". Часто ответ прост: данные грязные. Проблема не в аналитике, а в том, что данные, которые вы используете, содержат ошибки, дубликаты, пропуски и несовместимые форматы. Без профилирования и очистки данные становятся не инструментом, а источником ошибок.

Что такое качество данных и почему оно важно

Качество данных - это не абстрактное понятие. Это то, насколько данные соответствуют реальности и пригодны для принятия решений. Если в вашей базе клиентов 30% номеров телефонов не соответствуют формату, а 15% адресов не существуют, вы не сможете точно таргетировать рассылки, строить сегменты или оценивать эффективность маркетинга. Данные с низким качеством ведут к ложным выводам, потере денег и репутационным рискам.

В современных системах качество данных оценивается по шести ключевым параметрам:

- Точность - данные соответствуют реальности (например, возраст клиента - 32 года, а не 132).

- Полнота - нет пропущенных значений (например, все клиенты имеют указанный email).

- Согласованность - одинаковые данные представлены одинаково (например, "Москва" и "г. Москва" - это одна и та же запись).

- Уникальность - нет дубликатов (один клиент не должен встречаться 5 раз).

- Своевременность - данные актуальны (например, вы используете данные за 2025 год, а не за 2020).

- Доступность - данные можно получить в нужный момент и в нужном формате.

Без контроля этих параметров даже самые мощные BI-системы и ML-модели будут работать на основе мусора. И это не теория - исследования показывают, что компании теряют до 20% своего бюджета на аналитику из-за плохого качества данных.

Профилирование данных: как понять, что у вас на самом деле есть

Профилирование - это не просто просмотр таблицы. Это систематическое исследование данных, чтобы понять их структуру, содержание и связи. Представьте, что вы врач, а данные - это пациент. Профилирование - это первичный осмотр: измерение температуры, давления, анализ крови. Без этого вы не знаете, что лечить.

Профилирование состоит из трех уровней:

- Структурное профилирование - проверка типов данных, наличия NULL, длины строк, ограничений. Например: в поле "Телефон" указаны числа, а не текст? Есть ли записи с пустыми значениями?

- Контентное профилирование - анализ реальных значений. Какие значения встречаются чаще всего? Есть ли неожиданные символы? Например, в поле "Город" вы обнаруживаете "Санкт-Петербург", "Санкт-петербург", "СПб", "г. СПб" - это три разных значения, но одно и то же.

- Межреляционное профилирование - проверка связей между таблицами. Если в таблице заказов указан ID клиента, который отсутствует в таблице клиентов - это нарушение целостности. Такие ошибки часто остаются незамеченными, пока не начнется интеграция систем.

Результат профилирования - это не отчет, а карта рисков. Вы узнаете, где больше всего проблем: в каком столбце 40% пропусков, где встречаются неверные даты, где есть дубликаты по ключевым полям. Это позволяет сосредоточиться на самых критичных участках, а не тратить время на всю базу.

Очистка данных: от мусора к чистым данным

После профилирования вы знаете, где проблемы. Теперь - как их решить? Это задача очистки данных. Очистка - это не однократная операция, а набор повторяющихся действий, которые превращают хаос в структуру.

Вот основные действия, которые вы должны выполнять регулярно:

- Удаление дубликатов - не все дубликаты очевидны. Иногда один клиент записан как "Иван Петров" и "И. Петров". Нужны правила сопоставления, а не просто точное совпадение.

- Нормализация форматов - даты должны быть в одном формате (например, YYYY-MM-DD), телефоны - с кодом страны (+7), адреса - с единым написанием улиц.

- Исправление опечаток - "Москва" → "Москва", "Питер" → "Санкт-Петербург". Можно использовать справочники или алгоритмы расстояния Левенштейна.

- Заполнение пропусков - если в 70% случаев клиент из Москвы, а в 30% - пропущено, можно заполнить "Москва". Но только если это логично и не искажает аналитику.

- Устранение выбросов - возраст 200 лет? Сумма заказа 10 млн рублей при среднем чеке 2 тыс.? Это либо ошибка, либо мошенничество. Такие значения нужно либо исправить, либо исключить.

- Обогащение данными - подключить внешние источники: например, добавить регион по почтовому индексу или геолокацию по IP.

Очистка - это не волшебная кнопка. Это процесс, который требует правил. Без четких бизнес-правил вы рискуете испортить данные еще больше. Например, если вы замените все "Санкт-Петербург" на "СПб", вы потеряете возможность анализировать данные по полному названию города в отчетах.

Как профилирование и очистка работают вместе

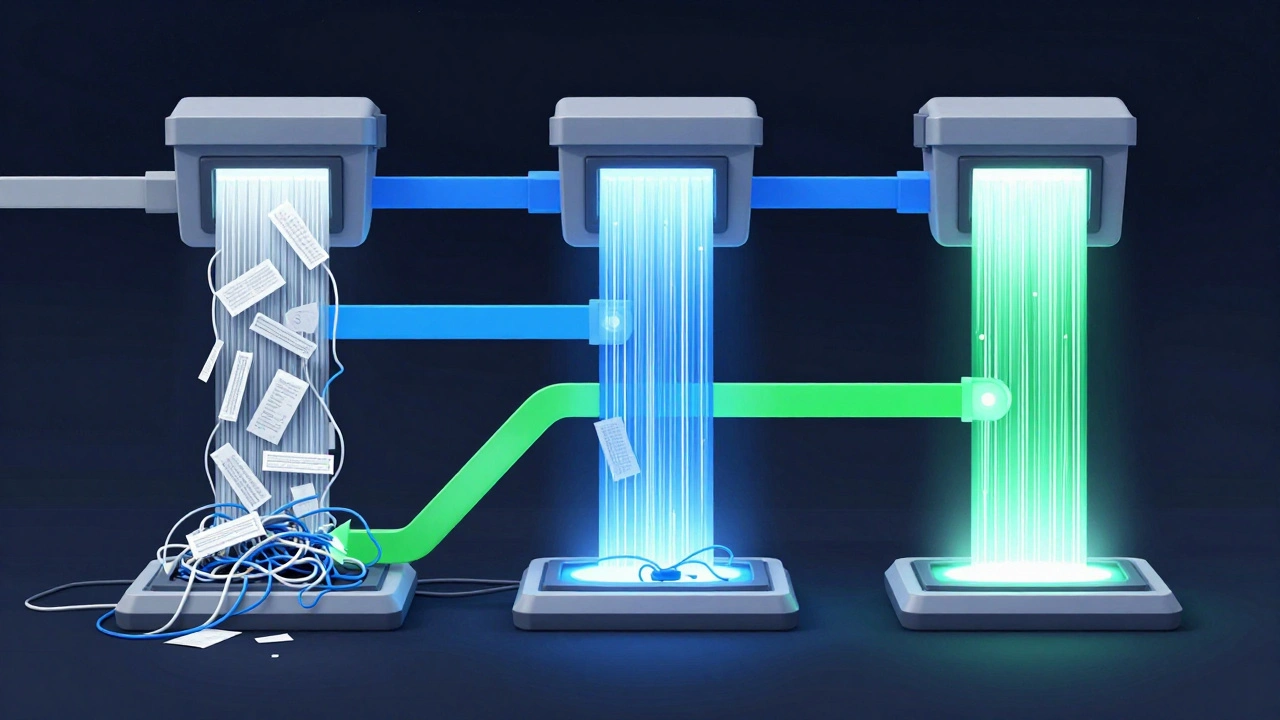

Профилирование показывает, что плохо. Очистка - как это исправить. Но они не работают по отдельности. Это единый цикл.

Представьте конвейер:

- Вы берете данные из CRM, базы заказов и сайта.

- Профилируете их - и发现: 18% телефонов не в формате +7, 12% дубликатов, 30% адресов не заполнены.

- Создаете правила очистки: привести все телефоны к формату +7 (XXX) XXX-XX-XX, удалить дубликаты по email, заполнить адреса из справочника.

- Применяете правила - и очищаете данные.

- Снова профилируете - чтобы проверить, исправились ли проблемы.

- Если да - данные готовы к анализу. Если нет - возвращаетесь к шагу 3.

Такой цикл повторяется на каждом этапе: при миграции данных, при интеграции новых источников, перед запуском ML-модели. Без профилирования после очистки вы не знаете, эффективна ли ваша работа. Без очистки профилирование - просто анализ без действия.

Где это применяется на практике

Профилирование и очистка - не роскошь, а необходимость в следующих сценариях:

- Миграция данных - когда вы переносите данные из старой системы в новую. Без очистки вы перенесете весь мусор.

- Интеграция источников - если вы объединяете данные из CRM, ERP и сайта, каждая система имеет свои правила. Без унификации вы получите хаос.

- Обучение моделей машинного обучения - ML-модель, обученная на данных с дубликатами и пропусками, будет давать ошибочные прогнозы. Например, модель предсказывает отток клиентов, но 30% клиентов в данных - это дубли. Она начинает "видеть" паттерны, которых нет в реальности.

- Отчетность и KPI - если в отчете по продажам участвуют дублированные заказы, вы будете думать, что продаете больше, чем есть на самом деле.

- Соответствие нормам - в финансах, здравоохранении, госсекторе есть требования к качеству данных. Нарушение - штрафы и проверки.

Что делать, если у вас нет специальных инструментов

Вы не обязаны использовать Pentaho, Talend или Power Query. Даже в Excel можно сделать многое:

- Используйте Условное форматирование, чтобы выделить дубликаты, неверные даты, слишком длинные строки.

- Примените формулы TRIM() и UPPER(), чтобы убрать пробелы и привести к единому регистру.

- Используйте Уникальные значения в сводных таблицах, чтобы найти дубликаты.

- Проверяйте данные с помощью ВПР - например, сверьте коды городов с эталонным списком.

- Создайте таблицу-справочник с корректными значениями и используйте ее для замены ошибок.

Главное - не ждать идеального инструмента. Начните с малого: возьмите один ключевой набор данных, пройдите через профилирование и очистку. Увидите разницу - и поймете, почему это нужно делать регулярно.

Как закрепить результат

Очистка - это не разовая операция. Это культура. Без контроля данные снова загрязнятся.

Чтобы качество не упало:

- Задайте бизнес-правила для каждого поля: "Телефон - только +7, 10 цифр, без скобок".

- Внедрите валидацию на входе - чтобы новые данные не попадали в систему в неправильном формате.

- Настройте мониторинг - раз в неделю автоматически проверяйте ключевые метрики качества: % пропусков, % дубликатов, % несоответствий.

- Создайте отчет о качестве данных - и показывайте его команде. Если качество падает - сразу действуйте.

Качество данных - это не задача аналитиков. Это задача всей организации. От тех, кто вводит данные в форму, до руководителя, который принимает решения на основе отчетов.

Чем профилирование данных отличается от очистки?

Профилирование - это диагностика: вы исследуете данные, чтобы понять, какие проблемы есть и где они находятся. Очистка - это лечение: вы исправляете найденные ошибки. Профилирование говорит: "Здесь 40% пропущенных значений". Очистка делает: "Заполняем пропуски на основе других данных".

Можно ли очистить данные без профилирования?

Технически - да, но это как чинить машину, не зная, где поломка. Вы можете удалить дубликаты или исправить даты, но не поймете, какие ошибки остались. Без профилирования вы рискуете оставить скрытые проблемы, которые испортят анализ позже.

Как часто нужно профилировать и очищать данные?

Зависит от того, как часто данные обновляются. Если данные поступают ежедневно - профилирование и очистка должны быть автоматизированы и запускаться каждый день. Если данные обновляются раз в месяц - достаточно раз в месяц. Главное - не ждать, пока качество упадет до критического уровня.

Какие ошибки в данных самые опасные?

Самые опасные - это скрытые. Например, дубликаты, которые не бросаются в глаза, или пропущенные значения, которые заменяются "по умолчанию". Они не вызывают ошибок при загрузке, но искажают статистику. Другая опасность - несоответствие форматов: "15.03.2026" и "03/15/2026" - в одной таблице это разные даты, и система может их не распознать.

Как проверить, что очистка сработала?

Повторно запустите профилирование после очистки. Сравните статистики: если процент пропусков упал с 25% до 2%, дубликаты исчезли, а форматы стали едиными - значит, очистка прошла успешно. Без этого сравнения вы не можете быть уверены, что сделали что-то полезное.